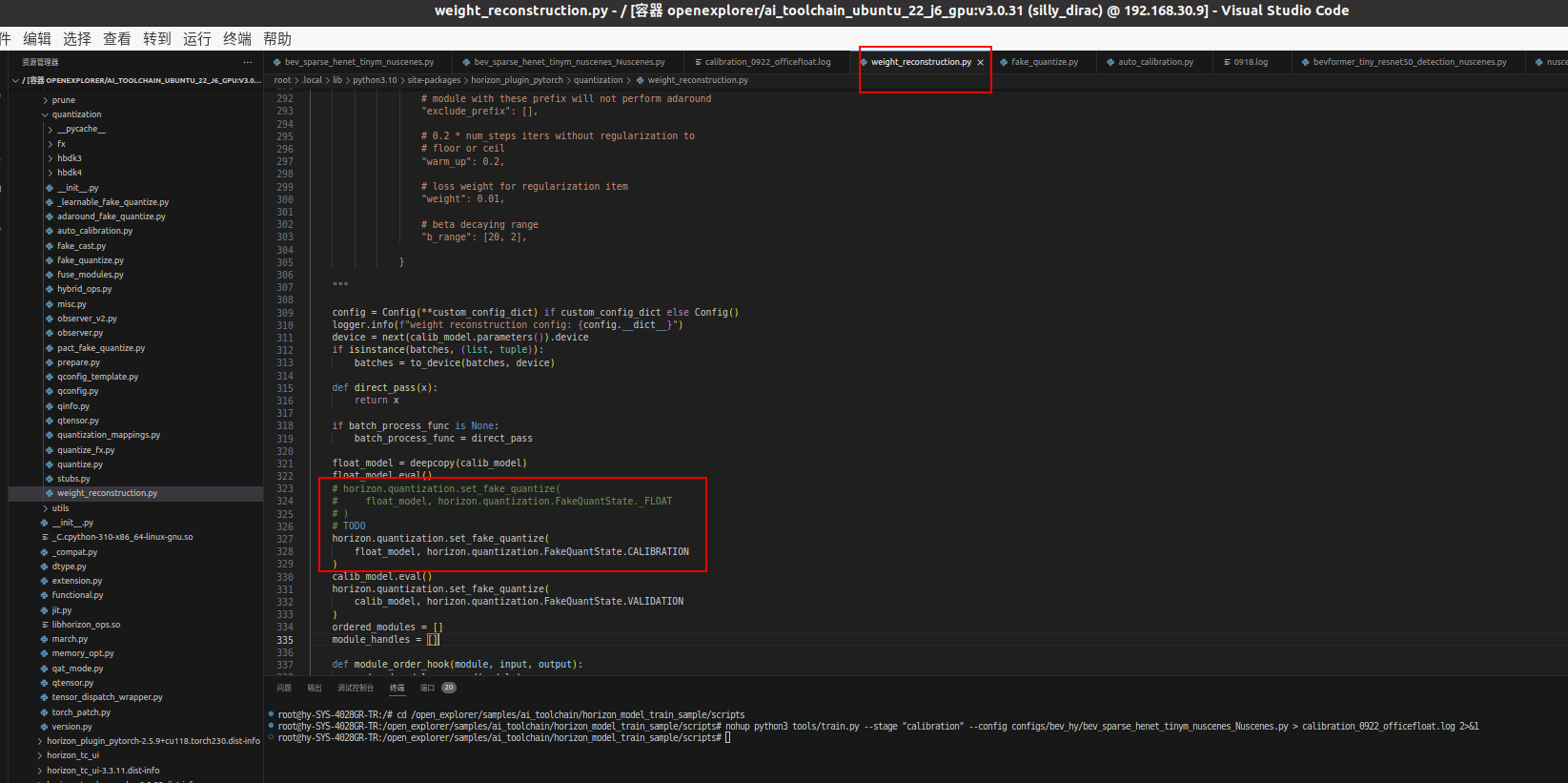

bev_sparse模型, 使用官方的float-checkpoint-best.pth.tar和官方calibration-checkpoint-best.pth.tar测试有精度和可视化结果,AP分别为0.434和0.4227, 使用Nuscenes自己训练的float模型经测试也有AP值和可视化结果,AP=0.3078 问题:使用上述官方的float-best和自己训练的float-best,去转calibration模型,AP值均为0且没有可视化结果,并且使用转换的calibration去训练qat模型时,回归损失都是0。测试日志和命令在附件中

专栏算法工具链bev_sparse模型转的calibration模型无AP和推理box

评论1

0/1000