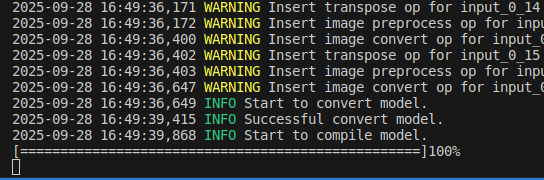

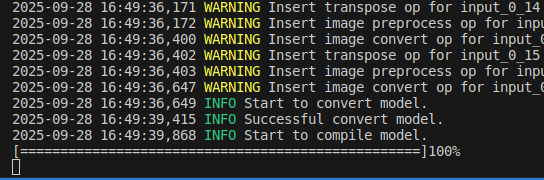

显示到100%后 十多个小时没有hbm文件生成,有可能是什么原因呢?

你好,当前问题解决了吗? 还是导不出来?

是onnx模型的问题吗?遇到过两次这种情况,这个问题的主要原因是什么呢?

2025-09-29 15:48:29.742275802 [E:onnxruntime:, sequential_executor.cc:572 ExecuteKernel] Non-zero status code returned while running Reshape node. Name:'Unsqueeze_141' Status Message: /onnxruntime_src/onnxruntime/core/providers/cpu/tensor/reshape_helper.h:45 onnxruntime::ReshapeHelper::ReshapeHelper(const onnxruntime::TensorShape&, onnxruntime::TensorShapeVector&, bool) input_shape_size == size was false. The input tensor cannot be reshaped to the requested shape. Input shape:{8}, requested shape:{1,1}