oe版本:3.0.31

执行:ptq量化时报错

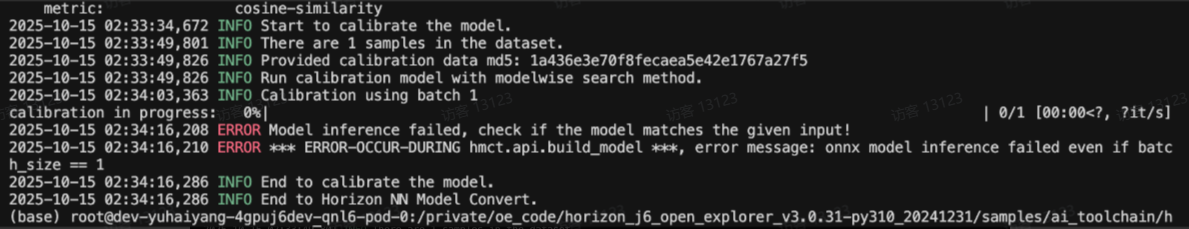

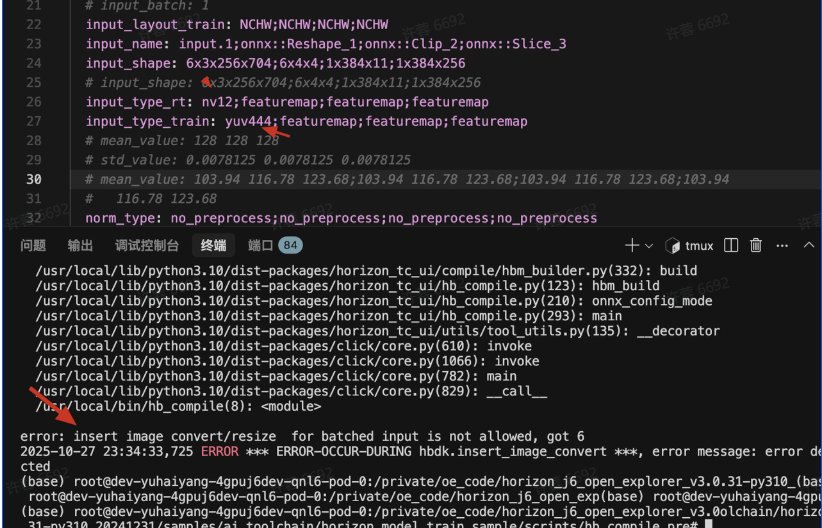

报错信息如下:

2025-10-1502:34:16,208 ERROR Model inference failed,check if the model matches the given input!

2025-10-1502:34:16,210 ERROR *** ERROR-OCCUR-DURING hmct.api.build_model***,error message: onnx model inferencefailed even if batch_size==1

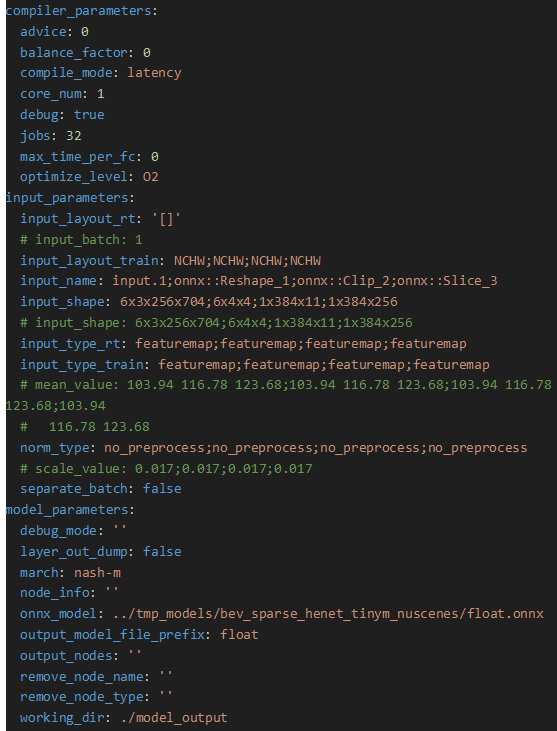

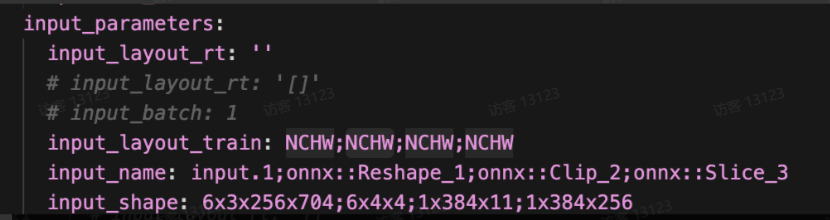

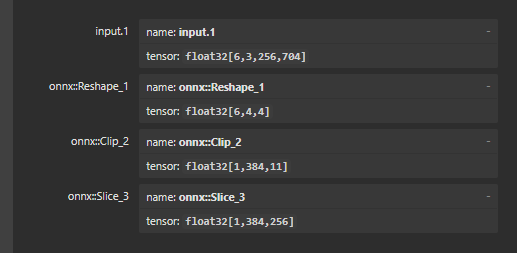

input_name: input.1;onnx::Reshape_1;onnx::Clip_2;onnx::Slice_3

input_shape: 6x3x256x704;6x4x4;1x384x11;1x384x256

已用hb_compile --fast-perf --model xxx.onnx --march nash-m做快速模型验证,能正常输出hbm模型。

请问大佬这个校准文件报错问题出在哪里,如何解决。

几点小疑问:

1.sparse 4d做ptq转换时,onnx的4个输入分别为(6,3,256,704),(6,4,4),(1,384,11),(1,384,256),fast-perf没问题,传统模式编译时,报batch_size错误,是否需要处理模型输入维度,比如统一改为batch_size=1

2.上述网络在做ptq转换时,是否有精度损失,损失能否控制在2%以内

如果做ptq量化编译,想利用配置文件ymal里面的图像预处理,一帧图像有6个视角,这样会报错。模型输入多张图像是否不能使用ptq编译时的图像预处理。

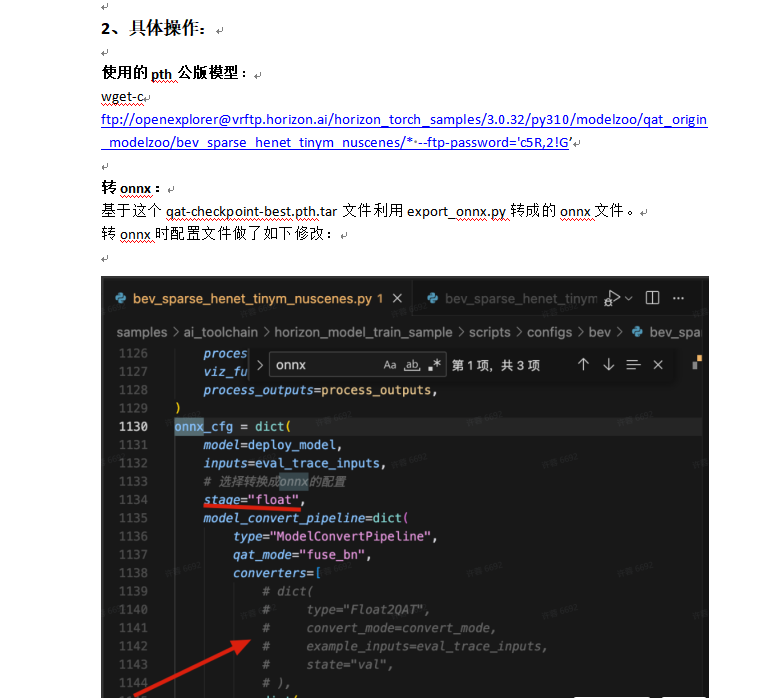

如果做ptq量化编译,想利用配置文件ymal里面的图像预处理,一帧图像有6个视角,这样会报错。模型输入多张图像是否不能使用ptq编译时的图像预处理。 这里你导出工具export_onnx是用的地平线的吗,还是toorch导出onnx官方导出工具,最好是用torch导出来,torch.export.onnx这个工具。我怕里面有一些细微差距导致导出来的onnx模型有差距从而导致量化失败

这里你导出工具export_onnx是用的地平线的吗,还是toorch导出onnx官方导出工具,最好是用torch导出来,torch.export.onnx这个工具。我怕里面有一些细微差距导致导出来的onnx模型有差距从而导致量化失败