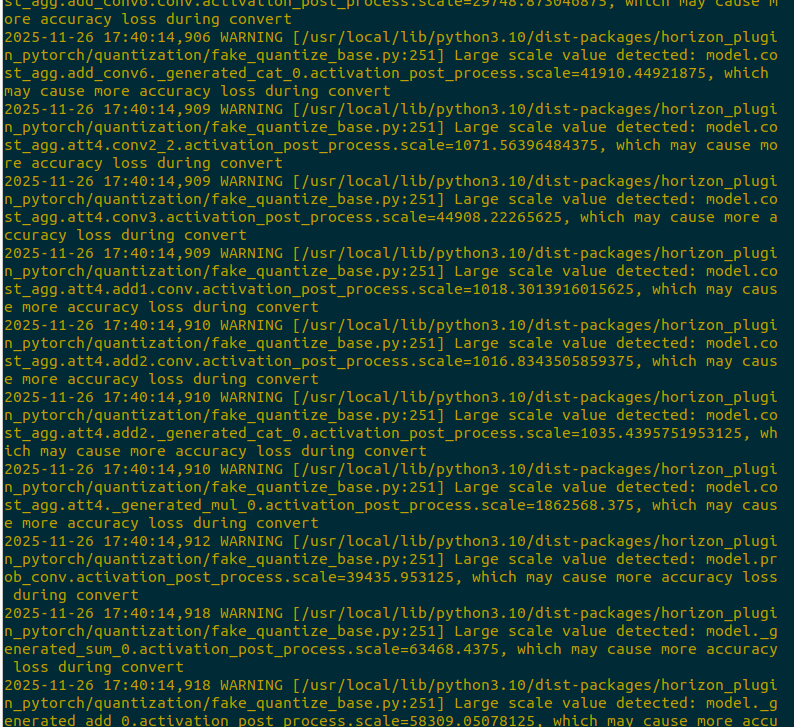

Large scale value detected: model.cost_agg.att4.add2.conv.activation_post_process.scale=1102.5093994140625, which may cause more accuracy loss during convert;,可能会导致精度损失,怎么解决,会导致Loss下降的慢,以及最终的hbm模型精度不好吗?

专栏算法工具链j6e上qat的过程中,显示scale太大

j6e上qat的过程中,显示scale太大

已解决

su2025-11-26

72

17

算法工具链

征程6

评论1

0/1000