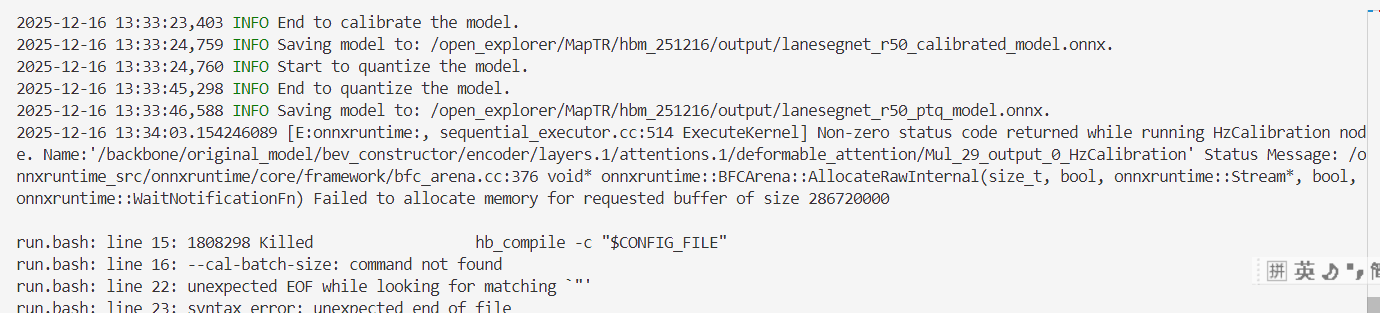

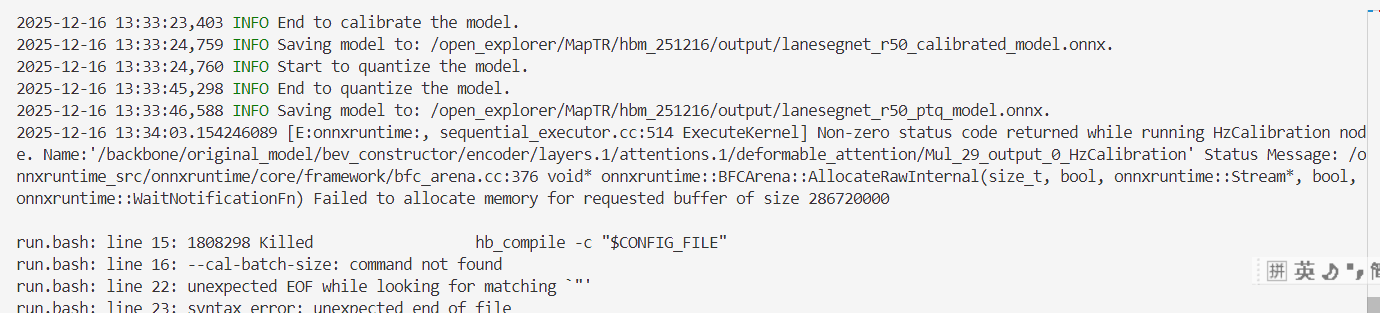

配置如下:O2,

配置如下:O2,cal_batch_size为1,但是实际转的时候会有提示说usingbatch为8,然后强转为1的点

配置如下:O2,

配置如下:O2,cal_batch_size为1,但是实际转的时候会有提示说usingbatch为8,然后强转为1的点

补充配置 # 模型参数组(无修改)model_parameters:onnx_model: '/open_explorer/MapTR/Wholemodel_v1_0_ep55.onnx'march: 'nash-m'output_model_file_prefix: 'lanesegnet_r50'working_dir: './output'debug_mode: ""# 输入信息参数组(保持四维形状)input_parameters:input_name: "input_img;navigation;ego_feature" input_type_train: "featuremap;featuremap;featuremap"input_layout_train: "NCHW;NCHW;NCHW"input_shape: "1x7x3x544x960;1x39x2;1x5" # input_batch: "1"input_type_rt: "featuremap;featuremap;featuremap"# 校准参数组(核心修正:确保4个映射,格式严格)calibration_parameters:cal_data_dir: '/data/horizon_j6/data/yua4/calidata/input_img/;/data/horizon_j6/data/yua4/calidata/navigation/;/data/horizon_j6/data/yua4/calidata/ego_feature/' # 根目录必须存在cal_data_type: 'float32;float32;float32' cal_data_layout: "NCHW;NCHW;NCHW"# 关键修正:用紧凑格式写4个映射,分号分隔且无多余空格/换行dir_pattern: "input_img;navigation;ego_feature"file_pattern: '*' # 匹配所有npy文件cal_batch_size: 1cal_image_num: 240 # 编译参数组(无修改)compiler_parameters:compile_mode: 'latency'core_num: 1optimize_level: 'O2'max_time_per_fc: 1000jobs: 4