芯片:J6M

oe版本:3.2.0

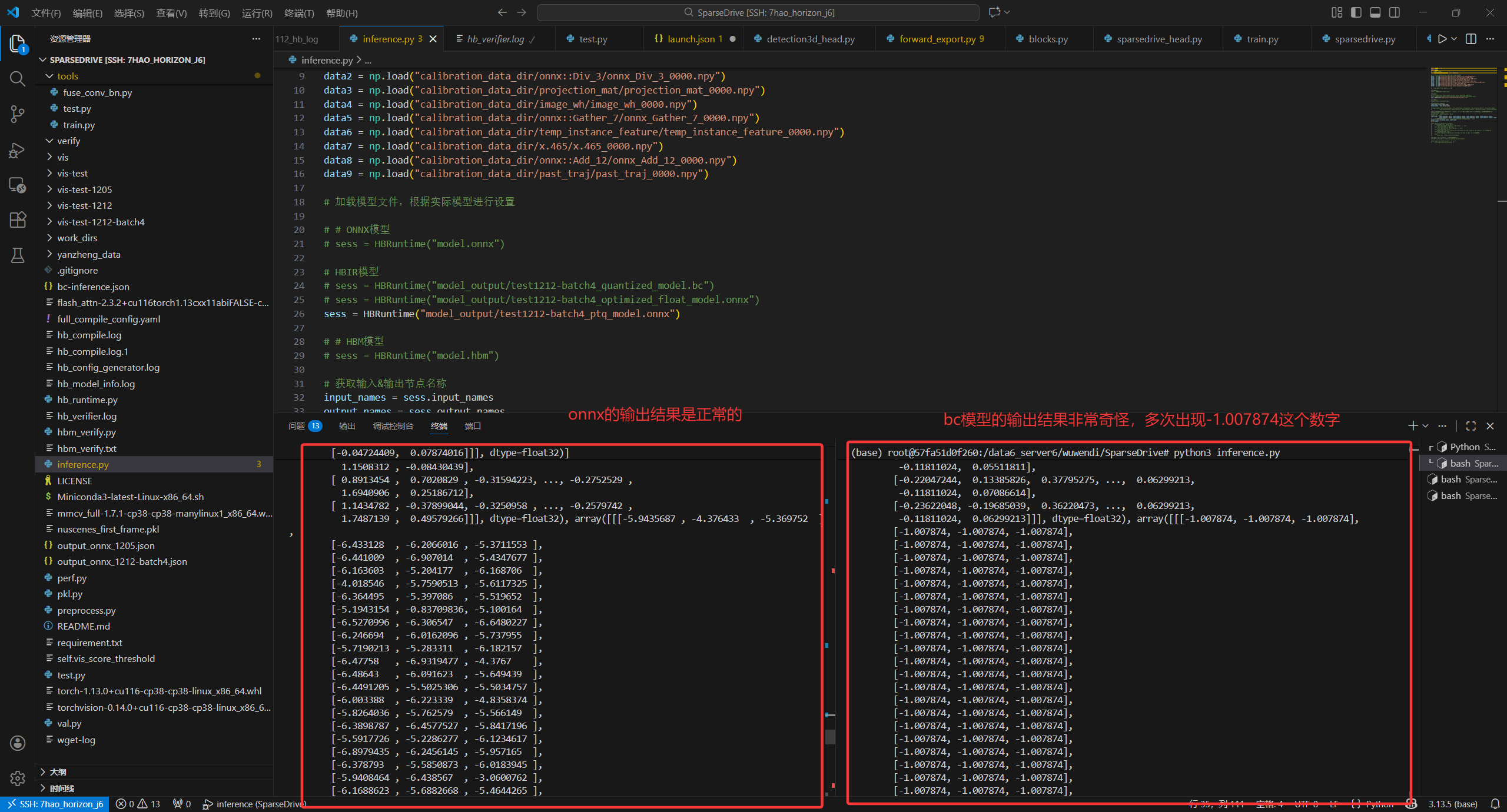

问题背景:目前已经使用hb_compile工具完成了模型的PTQ量化,使用的fast-perf模式;使用hb_model_info验证onnx模型和bc模型输入输出的顺序、形状完全一致;使用hb_verify验证optimized_float_model.onnx和quantized.bc,二者的输出相似度相对较低,如下图所示。

但是使用HBruntime工具对onnx和bc模型进行推理时,发现二者的推理结果相差极大(使用的同一份npy输入)。Onnx模型的推理结果是正确的,但bc模型的推理结果完全不同且非常怪异,推理结果中大量出现-1.007874这个数字