我转hbm的yaml如下

# decoder config

calibration_parameters:

cal_data_dir: ./calibration_data_dir_cup/decoder_inputs/noisy_action;./calibration_data_dir_cup/decoder_inputs/img_feature;./calibration_data_dir_cup/decoder_inputs/robot_feature;./calibration_data_dir_cup/decoder_inputs/text_feature;./calibration_data_dir_cup/decoder_inputs/text_token_mask;./calibration_data_dir_cup/decoder_inputs/timesteps;./calibration_data_dir_cup/decoder_inputs/joint_mask;./calibration_data_dir_cup/decoder_inputs/joint_relative_pos

quant_config: {

"model_config": {

"all_node_type": "int16"

}

}

compiler_parameters:

advice: 0

balance_factor: 0

cache_mode: enable

cache_path: 'cache'

compile_mode: latency

core_num: 1

jobs: 64

max_time_per_fc: 0

optimize_level: O2

input_parameters:

input_layout_train: NCHW;NCHW;NCHW;NCHW;NCHW;NCHW;NCHW;NCHW

input_name: noisy_action;img_feature;robot_feature;text_feature;text_token_mask;timesteps;joint_mask;joint_relative_pos

input_shape: 1x64x14x8;1x1600x256;1x14x1x256;1x14x256;1x14;1;1x14;1x14x14

input_type_rt: featuremap;featuremap;featuremap;featuremap;featuremap;featuremap;featuremap;featuremap

input_type_train: featuremap;featuremap;featuremap;featuremap;featuremap;featuremap;featuremap;featuremap

mean_value: ''

scale_value: ''

separate_batch: false

std_value: ''

model_parameters:

debug_mode: ''

march: nash-e

onnx_model: test_onnx_model_cup/decoder_step_patched1.onnx

output_model_file_prefix: decoder_opt

output_nodes: ''

remove_node_name: ''

remove_node_type: Quantize;Dequantize;Cast;Softmax

# remove_node_type: Quantize;Dequantize

working_dir: ./model_output_calib_decoder_cup

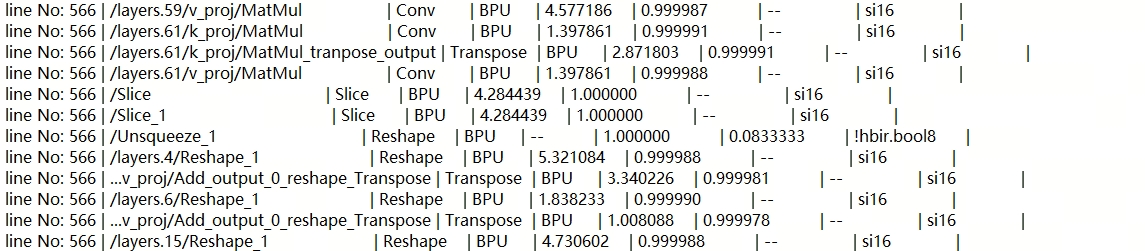

log以附件形式上传,麻烦各位看下是哪里的问题