J6M

OE:3.7.0

hbm文件模型推理结果与bc文件模型推理结果对不上,附件有代码截图和模型输出的相关信息,请问,我那么读取模型结果转换为三维向量的方法有什么问题?

J6M

OE:3.7.0

hbm文件模型推理结果与bc文件模型推理结果对不上,附件有代码截图和模型输出的相关信息,请问,我那么读取模型结果转换为三维向量的方法有什么问题?

C++对图像的处理逻辑这块,你通过bc模型已经验证了,这块没有问题。

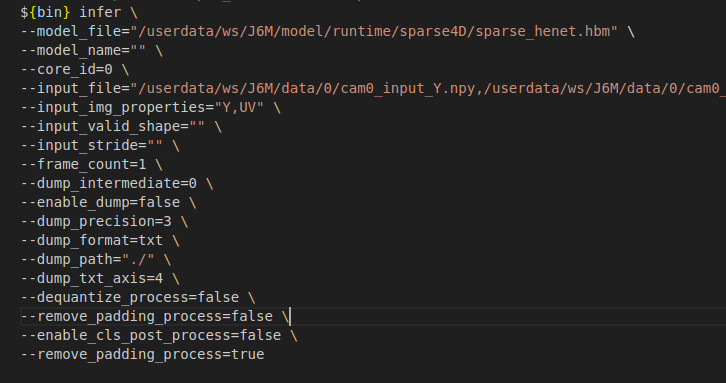

BC的output你用c++的后处理验证了OK,这块儿证明了C++的后处理与BC的推理结果是配套的,但不能说明C++后处理与hbm的output是配套的。BC的output 和 hbm的output是不一样的。这块可疑先通过配置项中不remove节点并且加上no_padding验证一下,这种情况下应该就是对齐的了。

有两个地方要特别注意:

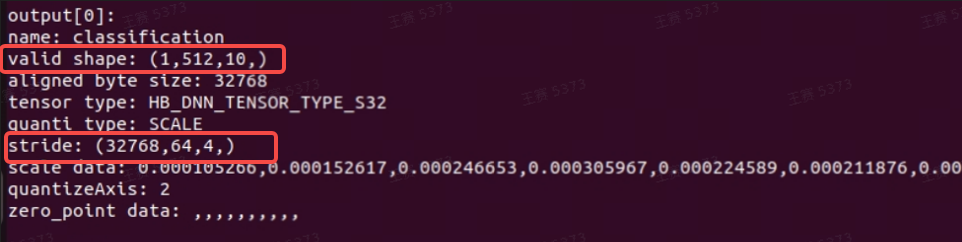

bc的output中对齐的浮点,带有反量化的节点,并且没有padding的数据。

hbm的output中根据配置可能移除了反量化的节点,并且有padding数据。

https://uisee.feishu.cn/wiki/NUhpwXVW1i0ZRjkkl96czp2onod?from=from_copylink