平台信息:J6M,OE版本:3.7.1

错误描述:

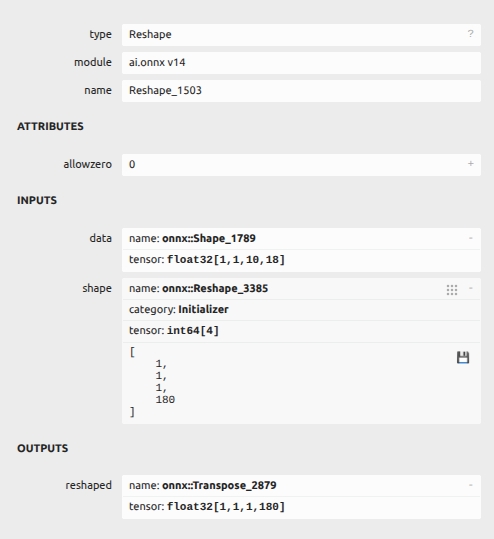

模型中的一个reshape节点无法转为多batch,1x1x18x10 -> 1x1x1x180;报错为The input tensor cannot be reshaped to the requested shape. Input shape:{8,1,10,18}, requested shape:{1,1,1,180}

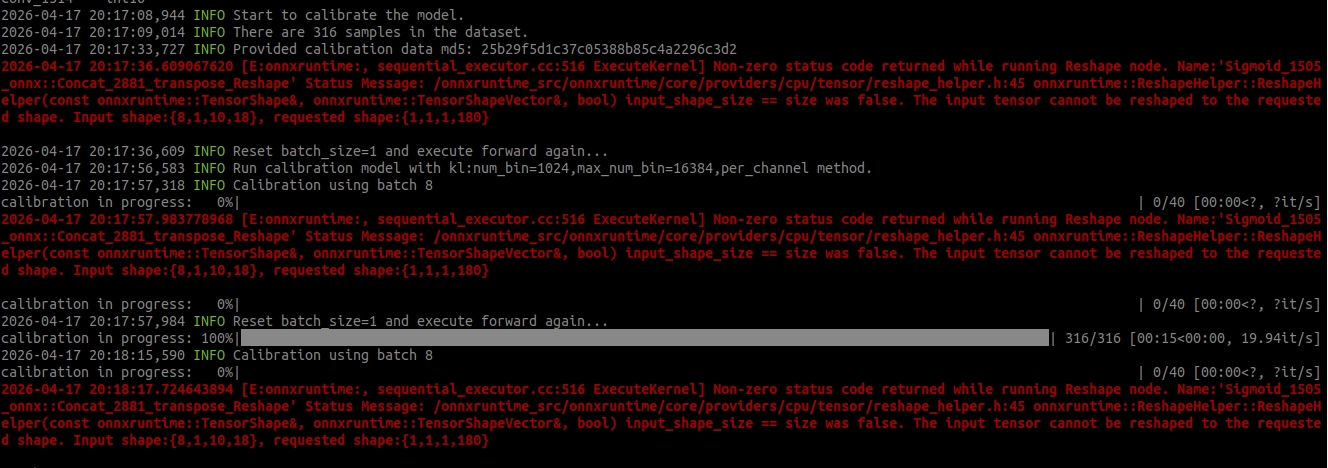

报错信息:

26-04-17 20:17:36.609067620 [E:onnxruntime:, sequential_executor.cc:516 ExecuteKernel] Non-zero status code returned while running Reshape node. Name:'Sigmoid_1505_onnx::Concat_2881_transpose_Reshape' Status Message: /onnxruntime_src/onnxruntime/core/providers/cpu/tensor/reshape_helper.h:45 onnxruntime::ReshapeHelper::ReshapeHelper(const onnxruntime::TensorShape&, onnxruntime::TensorShapeVector&, bool) input_shape_size == size was false. The input tensor cannot be reshaped to the requested shape. Input shape:{8,1,10,18}, requested shape:{1,1,1,180}

模型截图:

错误信息: