地平线的开发人员您好。

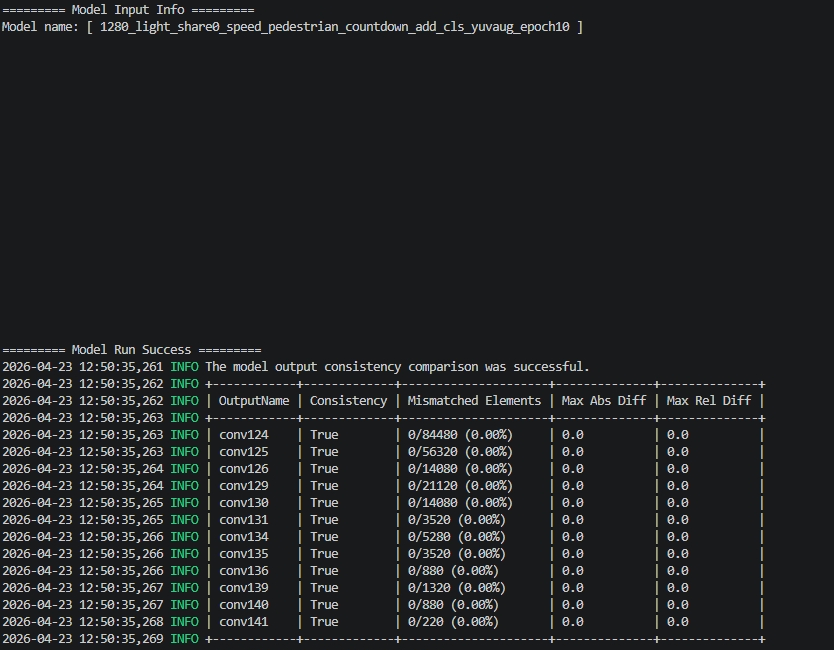

近期我们在做 YOLOX 红绿灯模型的板端部署对齐时,发现一个比较明确的问题,想请你们帮忙一起定位。

我们直接从板端获取同一张真实输入的 YUV(NV12) 数据,基于同一个输入文件,分别测试了:

在这个逐步部署的过程中,我们观察到一个很明显的现象:

- 模型对 light_share0 类别检测基本稳定,但 countdown_light(倒计时灯)这个类别的置信度随着部署链路推进逐步下降,最终在 PTQ / HBM 阶段,这个类别在常规阈值下基本就检不出来了。

本次所有测试都基于同一个板端输入:

- 输入文件:/jwsu/ocr_height/images/rm_img.yuv

- 格式:NV12

- 尺寸:1280x704

-模型:六分类

##附件说明##

1. input/rm_img.yuv

板端提供的真实输入,格式为 NV12,尺寸为 1280x704。

2. models/deploy_optimized_float_model.onnx

float ONNX 模型。

3. models/deploy_ptq_model.onnx

PTQ ONNX 模型。

4. models/deploy_wb_v20260420.hbm

HBM 模型。

ONNX 推理脚本,用于读取 rm_img.yuv,解码为 BGR 后送入单输入 ONNX。

HBM 推理脚本,用于读取 rm_img.yuv,拆分为 blob1_y 和 blob1_uv 后送入 HBM。

推理脚本依赖的后处理代码。

推理参考文档,包含 float ONNX、PTQ ONNX、HBM 的完整运行命令和输出说明。