环境信息

- 芯片/架构:J6,march: nash-m

- OE 工具链:HBDK 4.1.17,HB compile 3.3.11

运行环境:Docker

问题描述

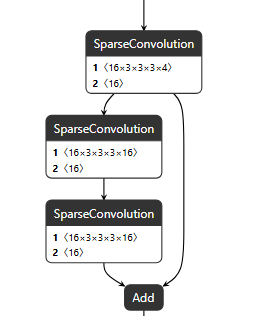

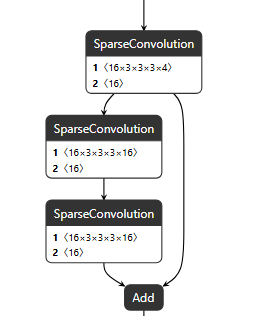

- J6 OE 当前是否支持 CenterPoint 这类 SparseConvolution / ScatterDense 算子?

如果不支持,官方推荐的 CenterPoint 适配方式是什么?

环境信息

运行环境:Docker

问题描述

如果不支持,官方推荐的 CenterPoint 适配方式是什么?

如果模型的稀疏度不高,或者稀疏结构可以通过填充变为规则结构,建议将稀疏卷积替换为标准密集卷积。

在模型导出前,将稀疏张量(Sparse Tensor)转换为密集张量(Dense Tensor)。

利用 BPU 对密集矩阵乘法的高度优化特性,通常能获得比 CPU 运行稀疏算子更高的整体吞吐量。

如果必须保留稀疏性以大幅减少输入数据量(如点云处理),可将稀疏索引提取逻辑移至 CPU或DSP,处理好的数据在给BPU处理。