芯片型号:J6M

OE版本:3.0.31

我的操作如下:

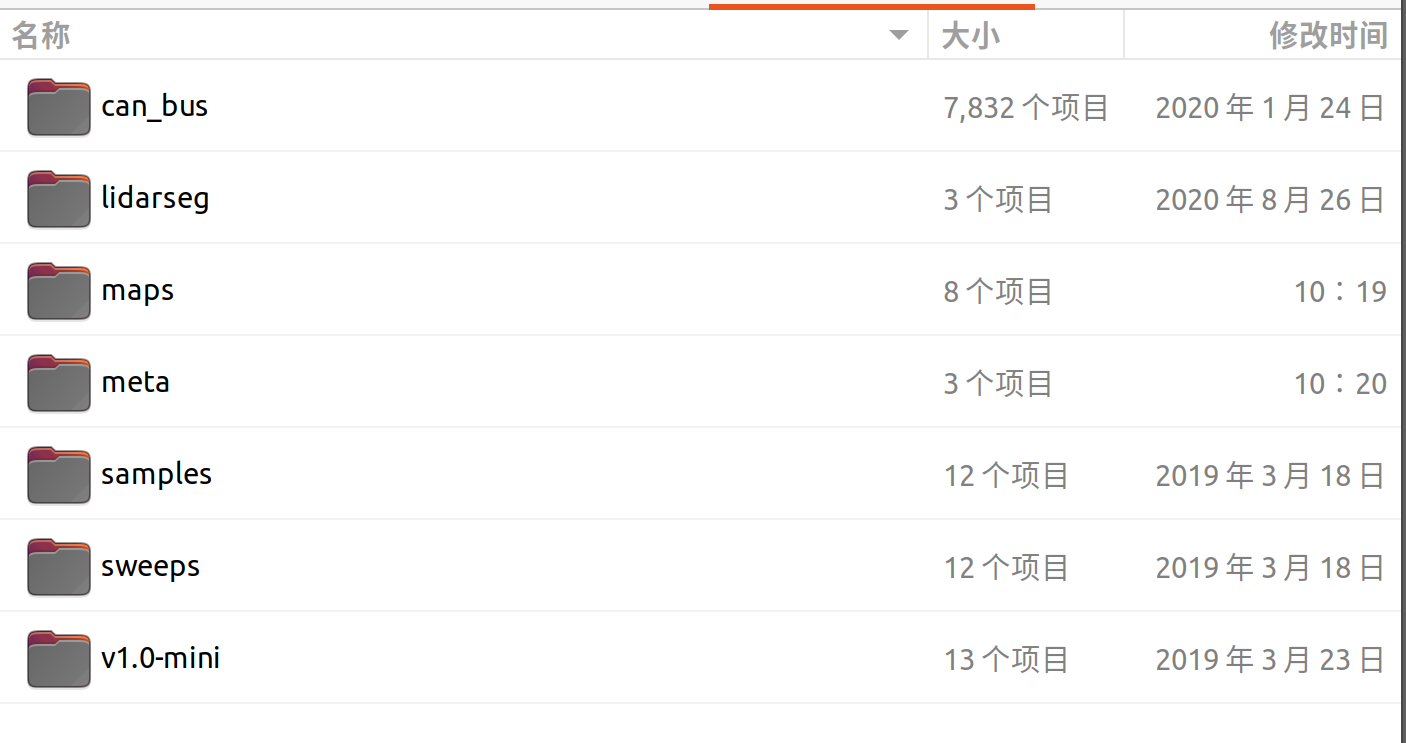

1. 将 nuscenes 的 mini 数据集按照要求放置

2. 使用 OE 中的 /open_explorer/samples/ucp_tutorial/dnn/ai_benchmark/j6/qat/tools/eval_preprocess 下的 bev_preprocess.py 文件执行后得到 nuscenes_bev 文件夹,idx.txt

3. 将 nuscenes_bev 文件夹,idx.txt 文件传输到板端,在板端使用 gen_file_list.sh 生成相应的 lst 文件

4. 使用 bash accuracy.sh 得到推理之后的 eval.log 文件

5. 将 eval.log 文件回传到本地 OE 中,使用 /media/hy/Docus/J6M/open_explorer/samples/ucp_tutorial/dnn/ai_benchmark/j6/qat/tools/python_tools/accuracy_tools 中的 bev_eval.py 得到指标

mini 数据的目录结构如下

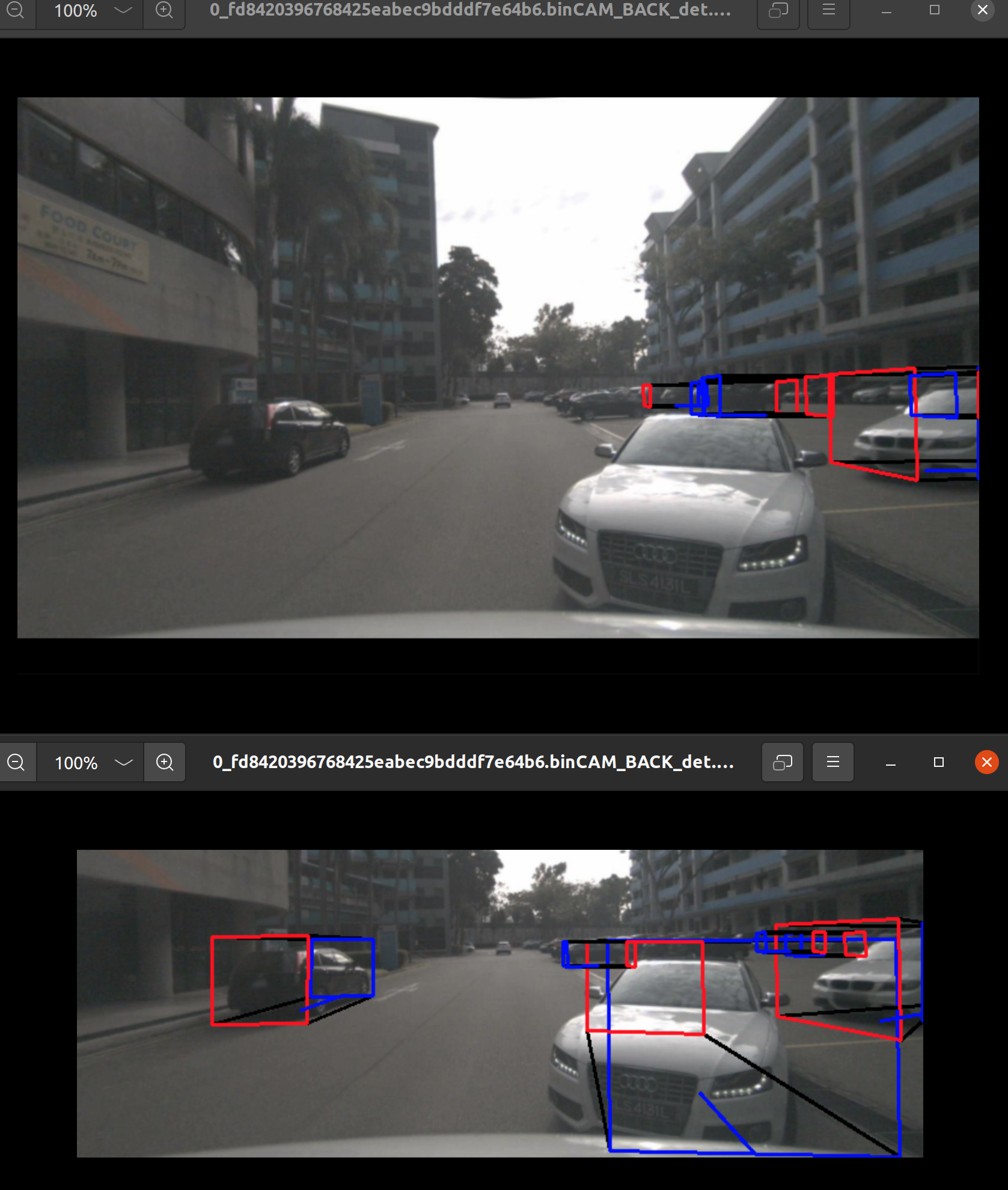

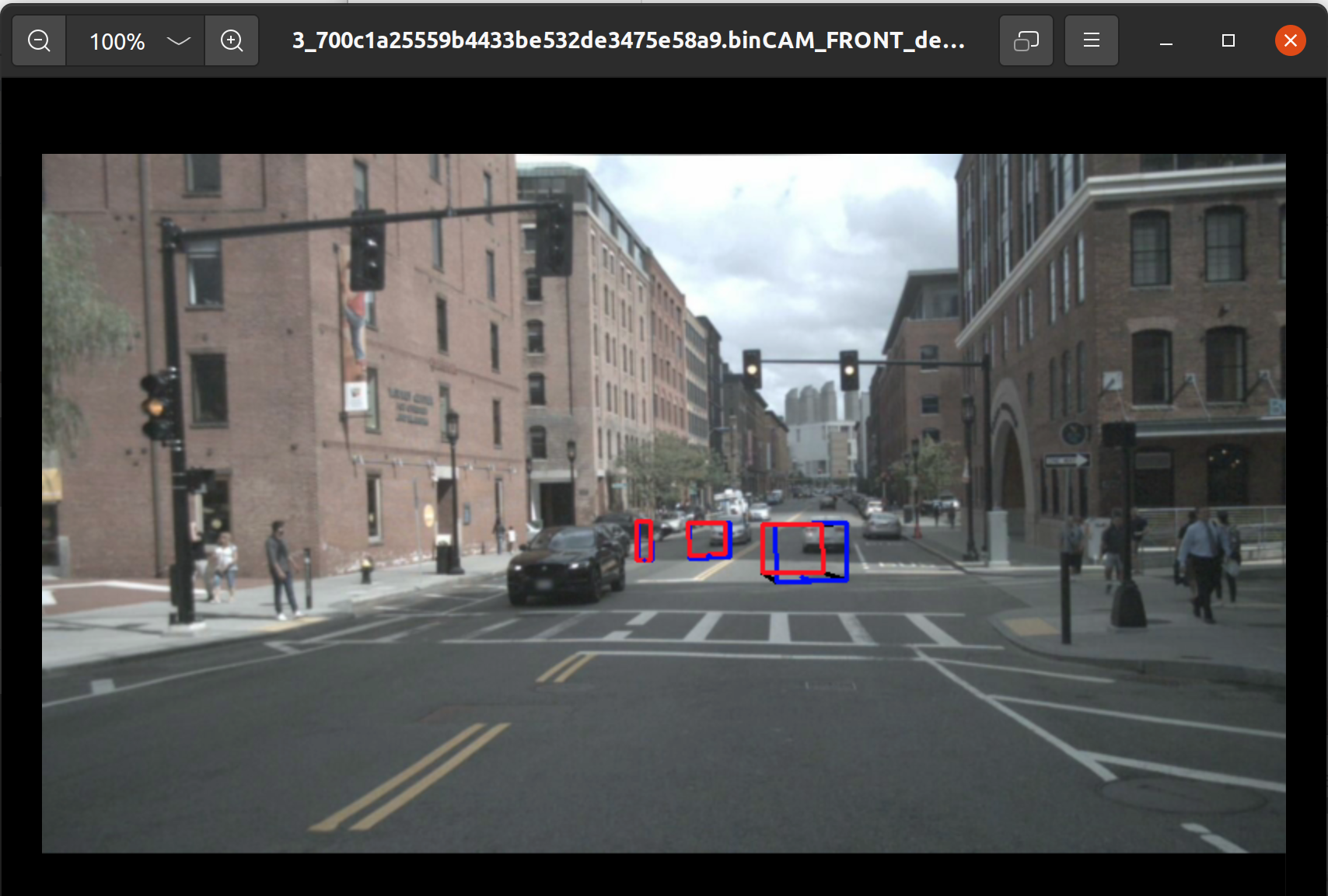

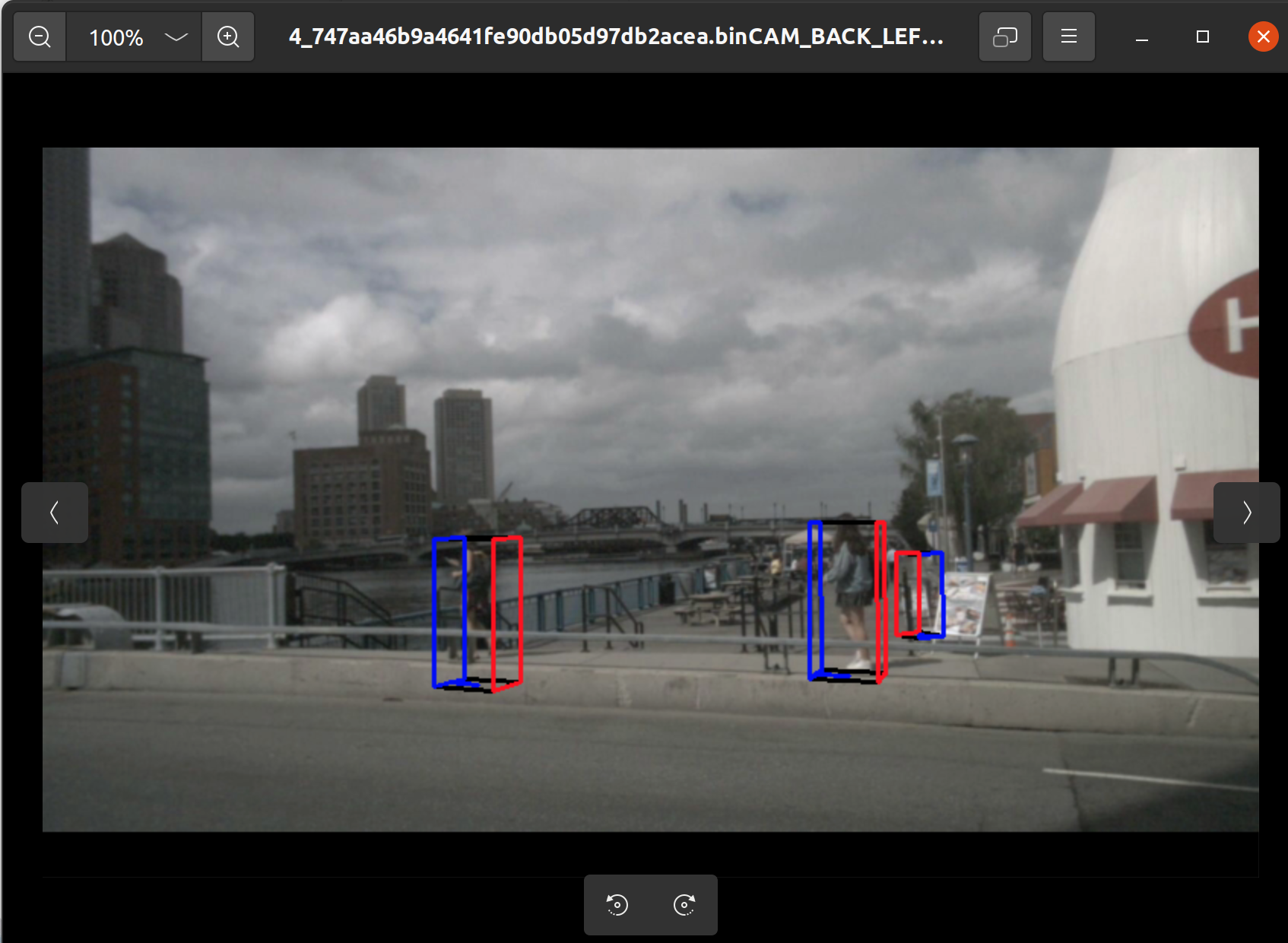

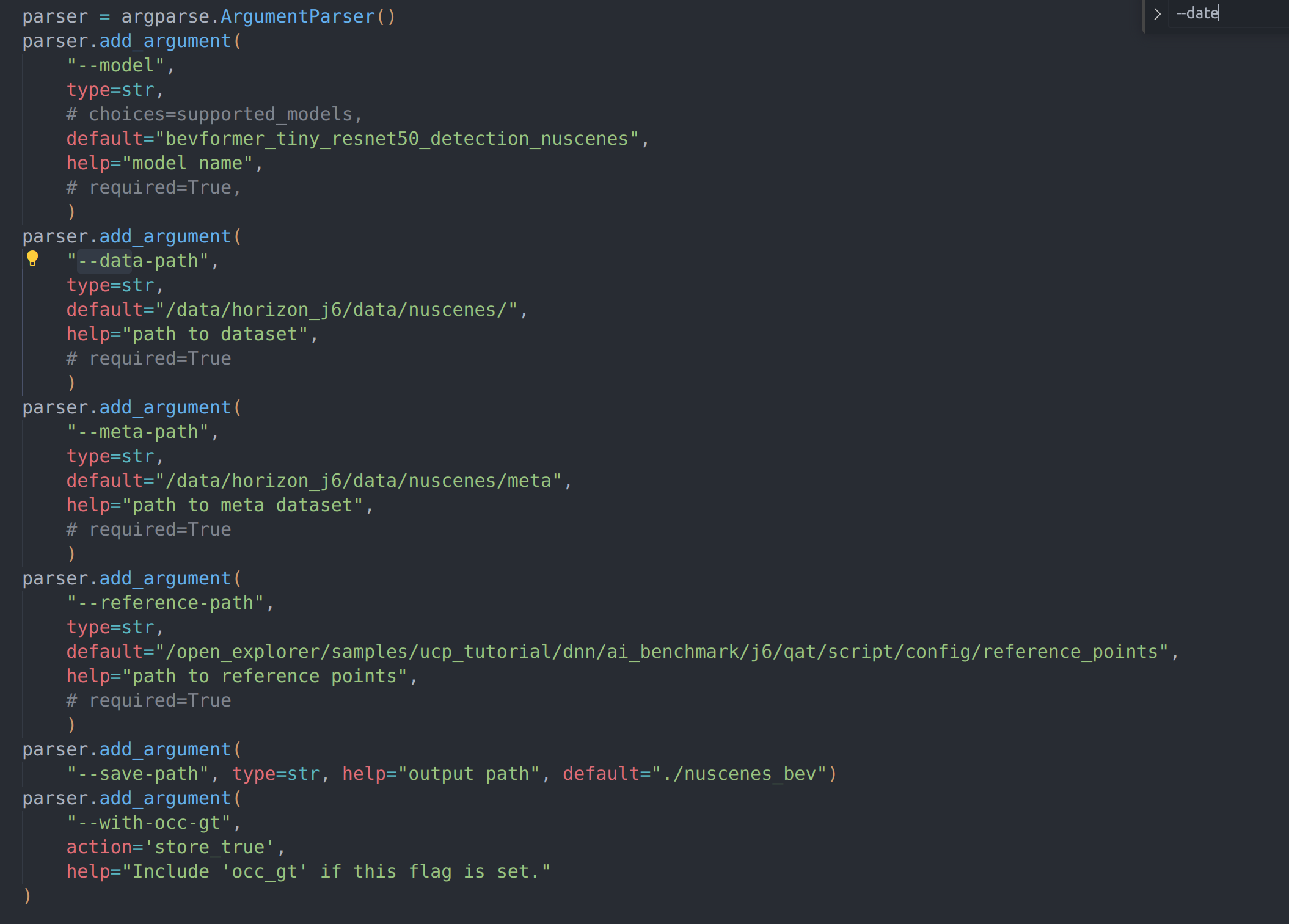

bev_preprocess.py 配置项如下

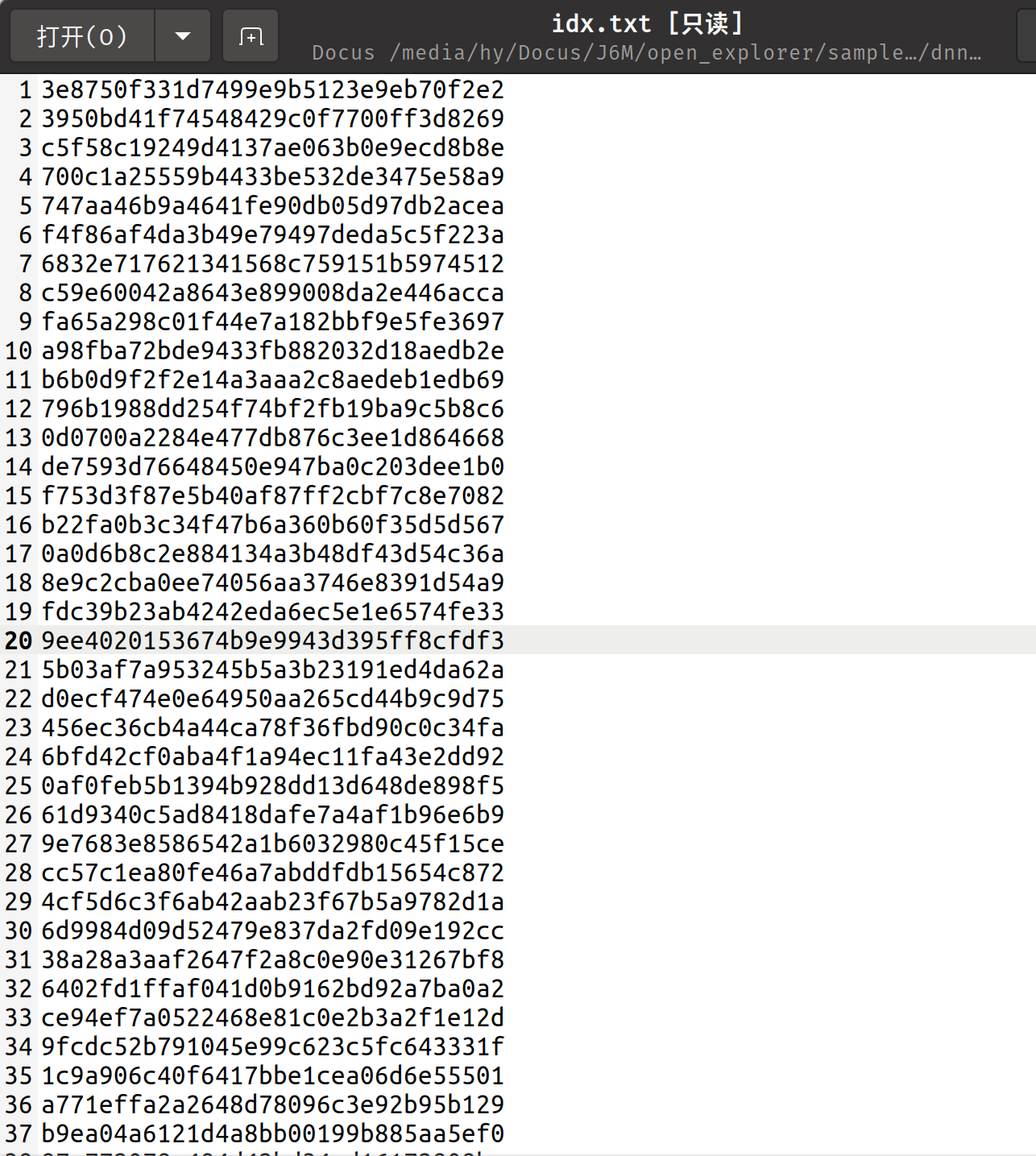

idx.txt 的内容如下

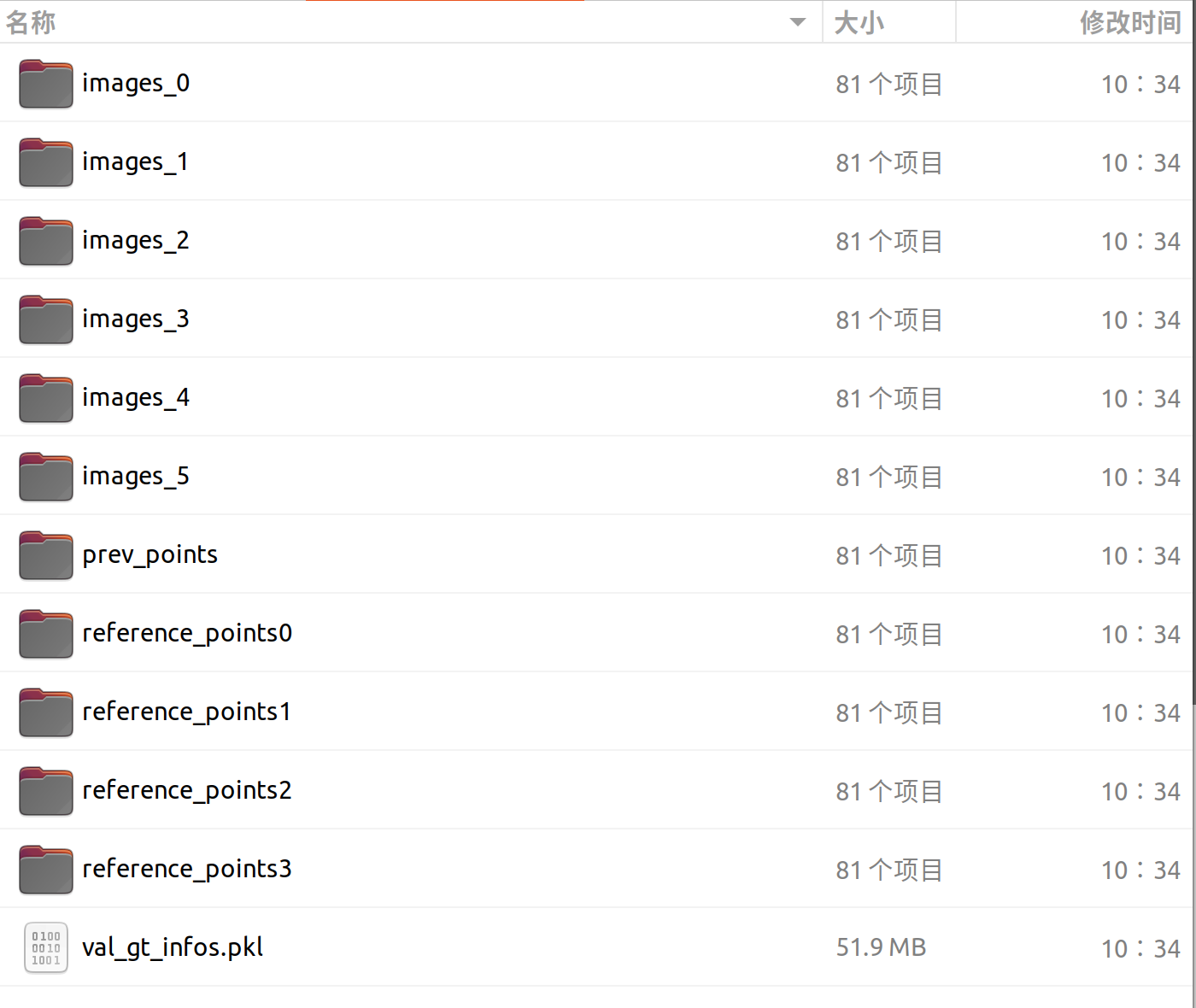

nuscenes_bev 目录的结构如下

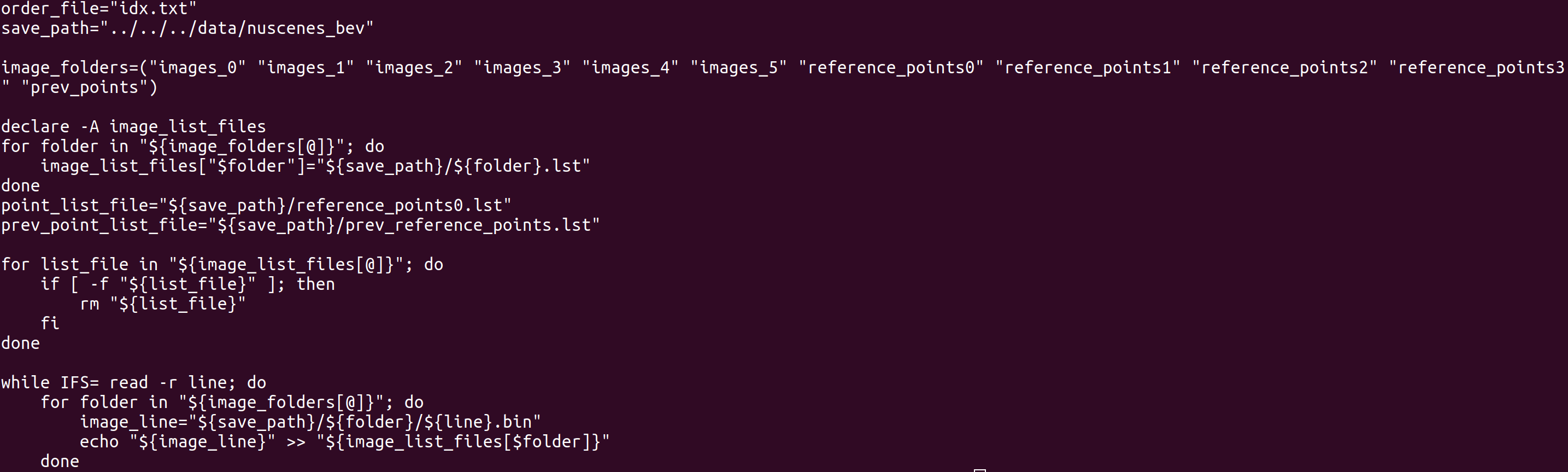

gen_file_list.sh 的内容如下

得到用于执行 accuracy.sh 的目录

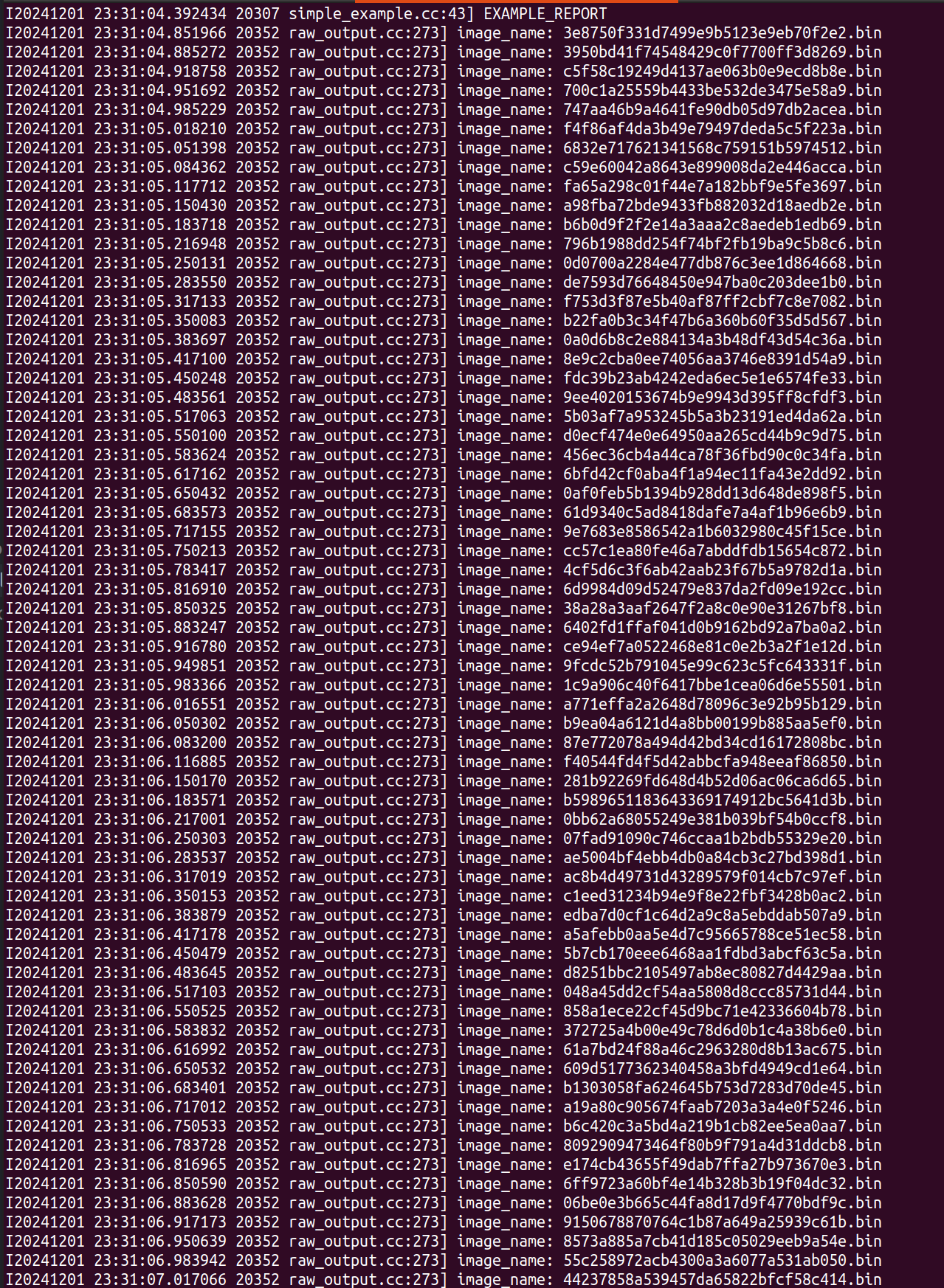

执行 bash accuracy.sh 的打印内容

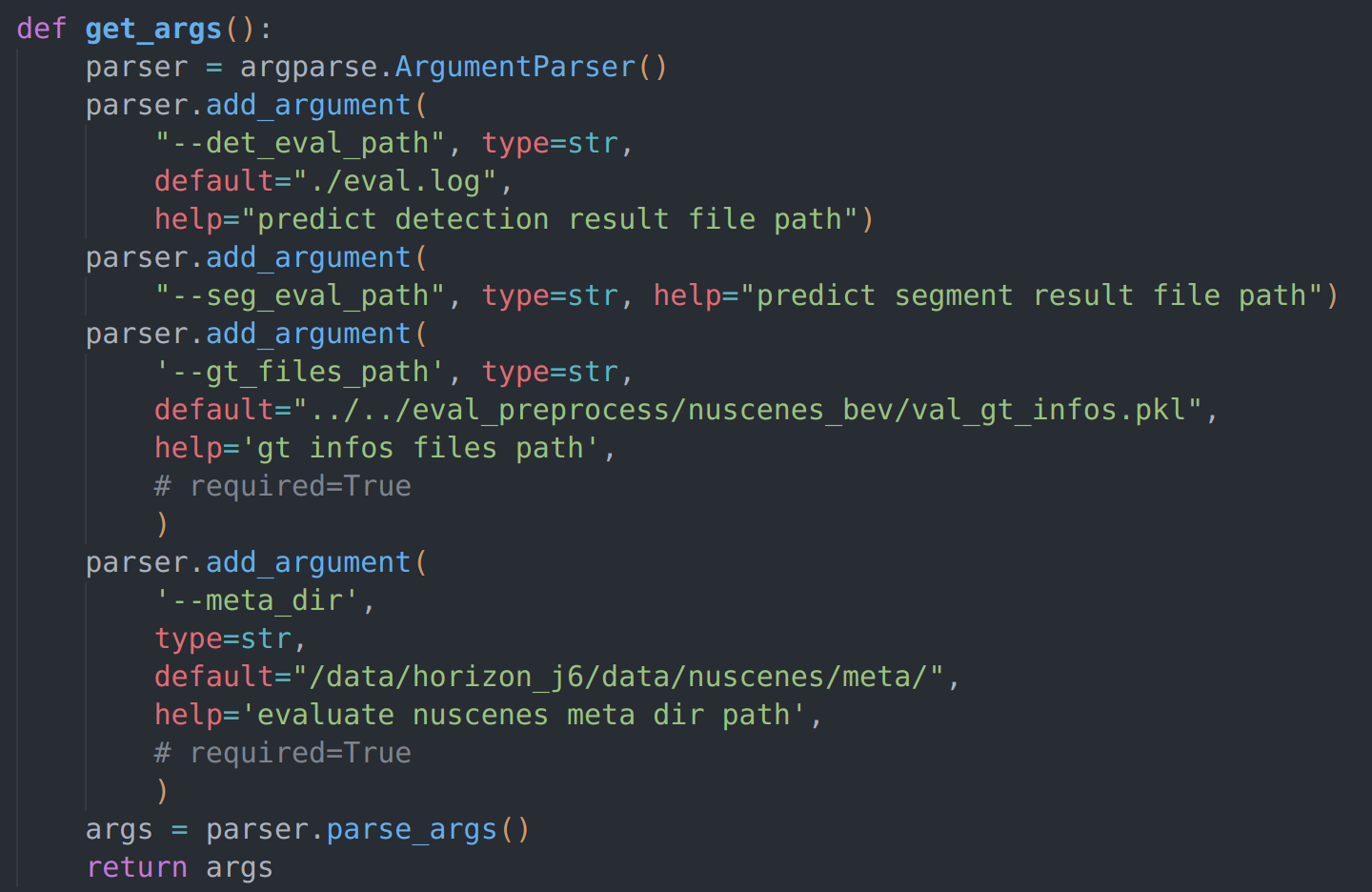

bev_eval 的配置

根据 eval.log 进行评估之后得到的结果